|

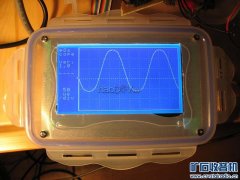

抽空做了个简单的激光测距的小东西,这个方案简单易实现,而且可以用现有的opencv库很容易作进一步性能改进。 之前在一个老外的网上看到介绍,现在找不到了。 基本原理:  这个图很清晰的解释了测距的基本原理,假设激光投射到目标物体上,同时位于同一平面的摄像头画面内能够捕捉到激光照射点,(所以要求摄像头和激光头之间的距离h不能太远),激光光线和摄像头成像轴完全平行。这样,照射到目标物体的激光点和摄像头成像平面连线和摄像头轴线之间会有一个夹角theta,通过在摄像帧图像里面对这个激光点相对于轴心的像素点的判断,可以确定出theta的大小,从而就能得到距离D。D越远,画面中激光点离中心越近,D越小,激光点离中心越远。画面的激光点判断可以简单的认为最亮的点就是激光点,逐像素扫描。当然可以使用opencv的API实现更复杂更精确的激光点确定方法。 整个算法比较简单但是很实用。 D很容易由下式得出:  所以只有一个未知量theta,theta由几个因素决定,一个是画面中激光点离轴心的距离pfc,这个可以通过帧画面的处理得到, 另外两个是固定量,和具体摄像头有关,每个摄像头都不一样,rpc表示每个像素的弧度(其实就是与pfc想乘的因子),还有一个是弧度偏移补偿量,用于矫正。  这样我们可以得到下式:  经过上面的分析,只有pfc一个变量,其他的都算已知量。那怎么得到rpc和ro呢? 可以通过实验得到: 在实际试验中先得到两组数据,分别是激光点离中心的距离和真实的距离D 矫正数据 光点离中心距离 D (cm) 61 137 137 64 代入 137 = 7.350/tan(61x+y) 64 = 7.350/tan(137x+y) 这样得到 Offset (ro) = 0.0053867 radians Gain (rpc) = 0.000795302 radians/pixel 采用的摄像头,很普通的那种,640*480像素  做好了的实验板:  代码: #include <iostream> using namespace std; #include "opencv/cv.h" (责任编辑:admin) |